GPT-4 er lansert

En språkmodell så avansert at den kan bestå advokateksamen.

Denne artikkelen er over to år gammel.

ChatGPT tok verden med storm da den ble lansert 30. november i fjor. Nå tar OpenAI kunstig intelligens til et helt nytt nivå med lanseringen av GPT-4, en språkmodell som er så avansert at den kan bestå advokateksamen.

Mange ble sjokkert da de så hva som var mulig med ChatGPT. En språkmodell som kan forstå og skrive tekst som et menneske vakte både entusiasme og forskrekkelse. Den var imidlertid bygget på «gammel» teknologi. I dag ble neste generasjon språkmodell lansert, og den er mye mer avansert enn GPT-3.5, som ChatGPT er bygget på.

For å sammenligne de to modellene, lot OpenAI begge de to modellene ta ulike tester og eksamener. På den amerikanske advokateksamen var resultatene til GPT-3.5 blant de 10 prosent dårligste. GPT-4 bestod testen med glans, og hadde et resultat blant de 10 prosent beste studentene.

- Den har fortsatt feil og begrensninger, men er mer kreativ enn tidligere modeller. Den hallusinerer mye mindre og er mindre forutinntatt, skriver OpenAI-sjef Sam Altman om GPT-4 på Twitter.

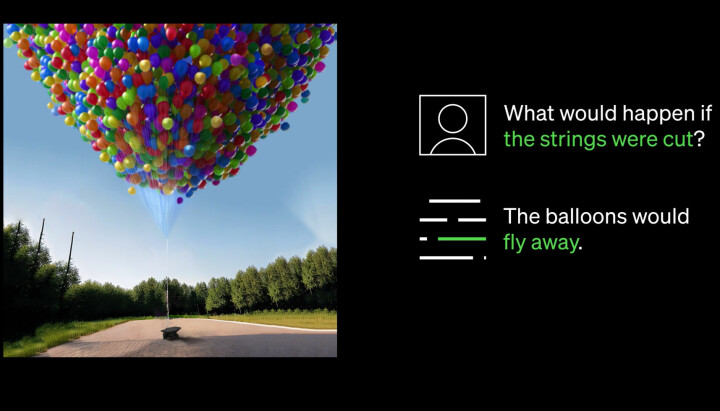

I tillegg til å tolke tekster, kan GPT-4 også tolke bilder, og beskrive innholdet i bilder med tekst. Mens GPT-3.5 hadde en grense på 3000 ord, kan GPT-4 behandle tekster på inntil 25 000 ord av gangen.

- I hverdagslige samtaler er ikke forskjellen på GPT-3.5 og GPT-4 så stor. Forskjellen merkes best når kompleksiteten i oppgavene passerer et visst punkt, skriver selskapet i pressemeldingen.

ChatGPT vil oppgraderes til å bruke GPT-4 for brukere som betaler 20 dollar pr. måned for ChatGPT Plus. Det er også mulig å sette seg på venteliste for å få tilgang til GPT-4 gjennom OpenAIs programmeringsgrensesnitt.

En enklere måte å teste GPT-4 på er å bruke Microsofts søkemotor Bing, for i dag ble det også bekreftet at nye Bing er bygget på GPT-4.

Flere samarbeidspartnere er allerede i gang med å bygge løsninger basert på GPT-4. Blant disse er Stripe, Morgan Stanley og Khan Academy. Appen Be My Eyes bruker GPT-4 til å assistere blinde og svaksynte.

- Hvis en bruker sender et bilde av innholdet i kjøleskapet sitt, vil Be My Eyes ikke bare identifisere innholdet i kjøleskapet, men også foreslå oppskrifter på retter som kan lages med de brukeren har i kjøleskapet, skriver selskapet i en bloggpost.

Microsoft har annonsert at de vil komme med nye lanseringer på torsdag. Det forventes da at flere av Office-produktene vil bli presentert med funksjonalitet drevet av GPT-4.